Материалы по тегу: периферийные вычисления

|

03.10.2025 [17:24], Руслан Авдеев

UKPN начнёт отапливать дома британских малоимущих кластерами из сотен Raspberry Pi

hardware

raspberry pi

великобритания

кластер

микро-цод

облако

отопление

периферийные вычисления

погружное охлаждение

сжо

экология

Британская UK Power Networks (UKPN) в рамках программы SHIELD (Smart Heat and Intelligent Energy in Low-income Districts) начала устанавливать микро-ЦОД на базе одноплатных компьютеров Raspberry Pi — для отопления домохозяйств, нуждающихся в деньгах для оплаты коммунальных услуг, сообщает The Register. Выбранные домохозяйства оснастят солнечными элементами питания и аккумуляторными системами, треть из них получит и систему HeatHub — сверхкомпактный ЦОД размером с большой тепловой насос, который заменит традиционные газовые котлы. Полученные в рамках пробного развёртывания данные используют для масштабирования SHIELD, к 2030 году UKPN намерена ежегодно развёртывать 100 тыс. систем. Платформа HeatHub разработана компанией Thermify. Она предназначена для запуска облачных контейнеризированных нагрузок. Каждый HeatHub включает до 500 модулей Raspberry Pi CM4 или CM5, погружённых в масло. Полученное тепло передаётся в системы отопления и горячего водоснабжения, а сам HeatHub легко установить вместо бойлера. HeatHub имеет собственное выделенное интернет-подключение. Над внедрением «низкоуглеродных» технологий SHIELD компания UKPN сотрудничает с Power Circle Projects, жилищной ассоциацией Eastlight Community Homes и Essex Community Energy. Также она участвует над установлением нового социального тарифа на отопление на востоке и юго-востоке Англии. Малоимущие клиенты будут платить фиксированную ставку в £5,60 ($7,52) ежемесячно, а SHIELD поможет им сократить счета за электричество на 20–40 %. Куратор SHIELD со стороны Eastlight Community Homes заявил, что результаты пилотного проекта обнадёживают, его планируют опробовать ещё в сотнях домов. Это поможет семьям поддерживать комфортные условия проживания, не беспокоясь о росте цен на энергию. Для обычных пользователей у Thermify иные условия — модуль для типового дома с тремя спальнями обойдётся в £2500 ($3365), ещё £500 ($673) возьмут за установку, а за отопление будут брать £50/мес. ($67/мес.). В особых случаях плата может быть снижена вдвое, а в экстремальных ситуациях тепло будет предоставляться бесплатно. Это уже не первый проект подобного рода. Так, Heata — изначально принадлежавшая British Gas, предлагает использовать серверы в качестве домашних водонагревателей, что позволяет сократить расходы на электричество для домовладельцев. Тепло вырабатывается за счёт рабочих нагрузок облачного оператора Civo. Также пару лет назад начала работать британская Deep Green — она обеспечивает теплом предприятия и бассейны с помощью мини-ЦОД, размещаемых на их территории.

09.09.2025 [17:00], Владимир Мироненко

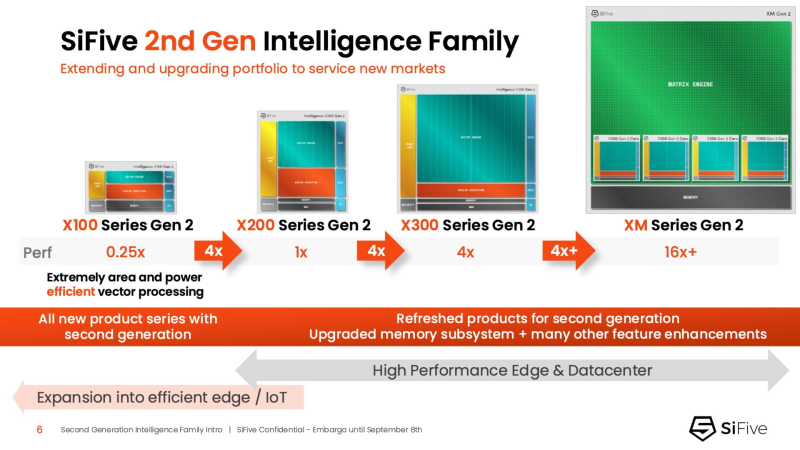

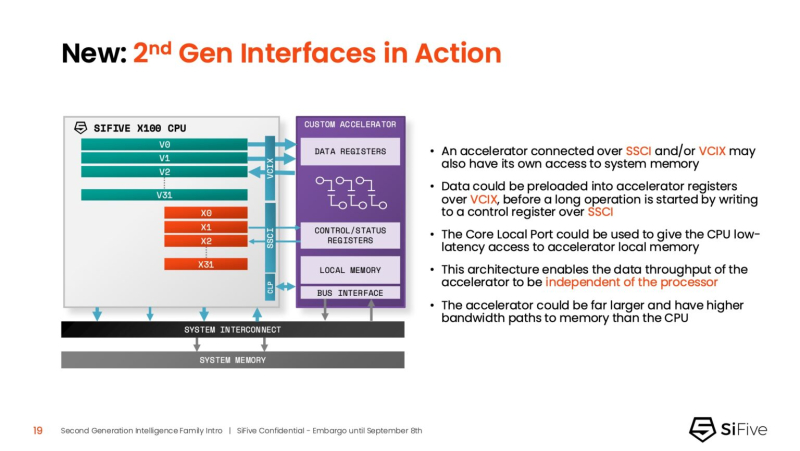

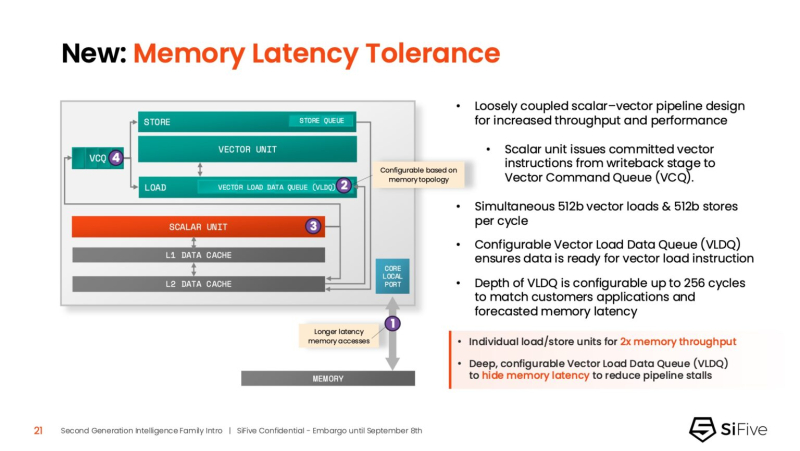

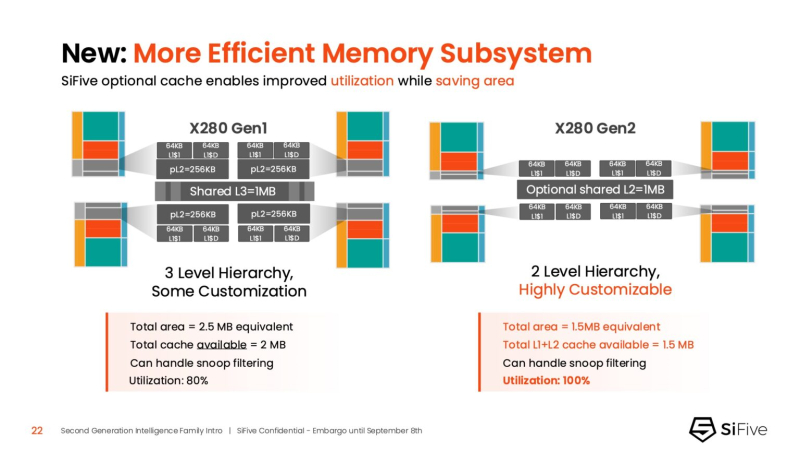

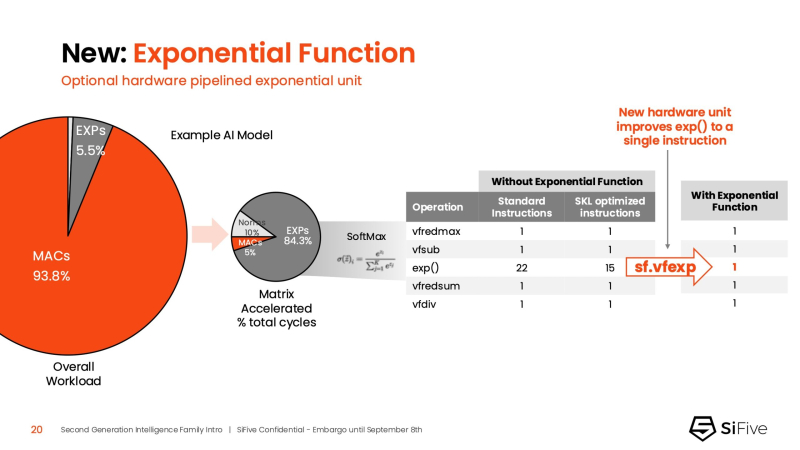

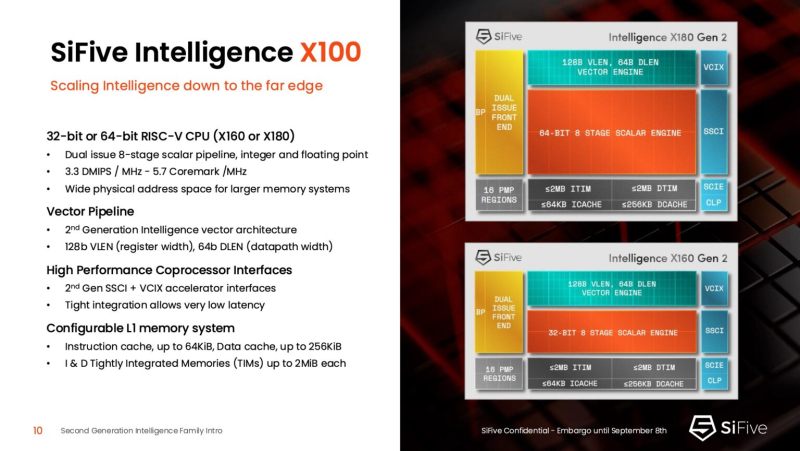

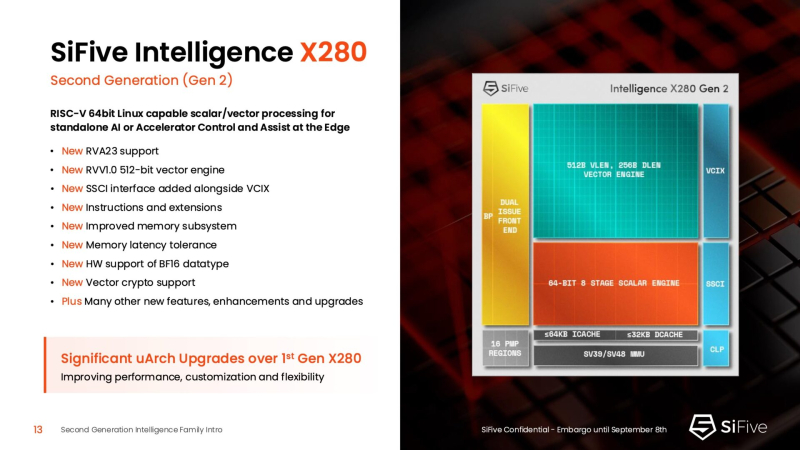

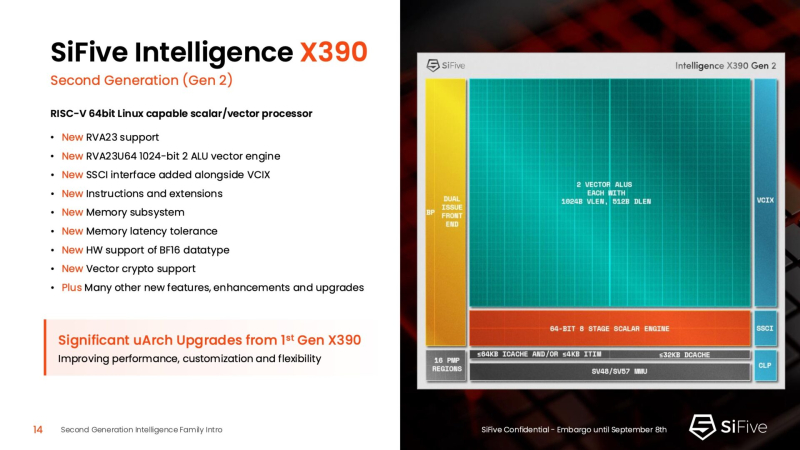

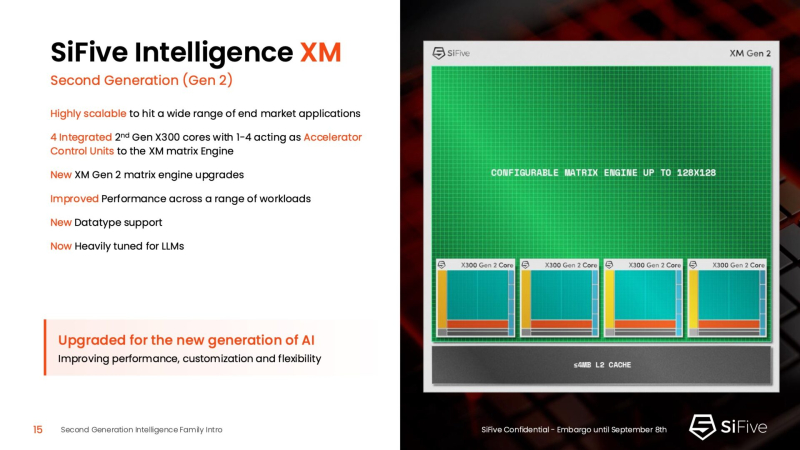

Быстрее и «умнее»: SiFive представила второе поколени RISC-V-ядер IntelligentSiFive представила семейство ядер Intelligent второго поколения с архитектурой RISC-V, включающее новые ядра X160 Gen 2 и X180 Gen 2, а также обновлённые решения X280 Gen 2, X390 Gen 2 и XM Gen 2. Новые решения разработаны для расширения возможностей скалярной, векторной и, в случае серии XM, матричной обработки данных, адаптированных для современных задач в сфере ИИ. Как отметил ресурс EE Times, анонсируя новую линейку продуктов, SiFive стремится воспользоваться быстрорастущим спросом на решения для обработки ИИ-нагрузок, который, по прогнозам Deloitte, вырастет как минимум на 20 % во всех технологических средах, включая впечатляющий скачок на 78 % в сфере периферийных вычислений с использованием ИИ. Ядра SiFive второго поколения позволяют решать критически важные задачи в области внедрения ИИ, в частности, в области управления памятью и ускорения нелинейных функций. Ключевым нововведением в процессорах серии X является их способность функционировать в качестве блока управления ускорителем (ACU). Это позволяет ядрам SiFive обеспечивать основные функции управления и поддержки для ускорителя заказчика через интерфейсы SiFive Scalar Coprocessor Interface (SSCI) и Vector Coprocessor Interface eXtension (VCIX). Данная архитектура позволяет заказчикам сосредоточиться на инновациях в обработке данных на уровне платформы, оптимизируя программный стек. Джон Симпсон (John Simpson), главный архитектор SiFive, сообщил ресурсу EE Times, что интеллектуальные ядра SiFive обеспечивают гибкость, сокращают трафик системной шины за счёт локальной обработки на чипе ускорителя и обеспечивают более тесную связь для задач пред- и постобработки. Он рассказал, что SiFive представила два важных усовершенствования в архитектуре, которые напрямую устраняют узкие места производительности: устойчивость к задержкам памяти и более эффективную подсистему памяти. Функцию Memory Latency Tolerance позволяет снизить задержку загрузки. Симпсон рассказал, что блок скалярных вычислений, обрабатывающий все инструкции, отправляет векторные инструкции в очередь векторных команд (VCQ). При обнаружении такого инструкции одновременно отправляется запрос в подсистему памяти (кеш L2 или выше). Ранняя отправка запросов, отделённая от исполнения, позволяет быстрее получить ответ от памяти и поместить его в переупорядочиваемую настраиваемую очередь загрузки векторных данных (VLDQ). Это гарантирует готовность данных к моменту, когда инструкция в конечном итоге покинет VCQ, что приводит к «загрузке вектора в течение одного цикла». Симпсон подчеркнул конкурентное преимущество решения, отметив: «Xeon, представленный на Hot Chips, может обслуживать 128 невыполненных запросов, и это топовый показатель для Xeon, а в нашем четырёхъядерном процессоре этот показатель составляет 1024». Эта «прекрасная технология» обеспечивает непрерывную обработку данных, эффективно предотвращая простои конвейера. Более эффективная подсистема памяти, которая представляет собой ещё одно существенное обновление, основана на переходе от инклюзивной к неинклюзивной иерархии кешей. В инклюзивной системе кеширования предыдущего поколения данные из общего кеша L3 реплицировались в частные кеши L1/L2, что компания посчитала неэффективным расходом «кремния». Конструкция ядер второго поколения исключает копирование, что, по словам Симпсона, даёт «в 1,5 раза большую производительность по сравнению с первым поколением» при меньшей занимаемой площади на кристалле. SiFive также интегрировала новый аппаратный конвейерный экспоненциальный блок. В то время как MAC-операции доминируют в рабочих ИИ-нагрузках, возведение в степень становится следующим серьёзным узким местом. Например, в BERT LLM, ускоренных матричным движком, операции softmax, включающие возведение в степень, занимают более 50 % оставшихся циклов. Программными оптимизациями SiFive сократила выполнение функции возведения в степень с 22 до 15 циклов, а новый аппаратный блок сокращает её до одной инструкции, уменьшая общее время выполнения функции до пяти циклов. Программный стек для семейства Intelligence второго поколения поддерживает масштабируемость. В серии XM среда выполнения машинного обучения уже распределяет рабочие нагрузки между несколькими кластерами XM на одном кристалле. Впрочем, пока масштабирование за пределы одного кристалла требует дальнейшей разработки библиотеки межпроцессорного взаимодействия (IPC). Флагманские решения X160 Gen 2 и X180 Gen 2 могут быть настроены для работы под управлением операционной системы реального времени, пишет SiliconANGLE. 32-бит IP-ядро Intelligence X160 разработано для оптимизации энергоэффективности и приложений с жесткими ограничениями по площади кристалла, в то время как 64-бит IP-ядро Intelligence X180 обеспечивает более высокую производительность и лучшую интеграцию с более крупными подсистемами памяти, сообщил ресурс CNX-Software. X160 поставляется с кеш-памятью объёмом до 200 КиБ и памятью объёмом 2 МиБ. Помимо промышленного оборудования, ядро может найти применение в потребительских устройствах, таких как фитнес-трекеры. Кроме того, X160 можно установить в системах с несколькими ИИ-ускорителями для управления чипами и предотвращения изменения прошивки. Благодаря двум встроенным кешам общей ёмкостью более 4 МиБ ядро позволяет работать с большим объёмом данных. По данным SiFive, X160 подходит для обучения ИИ-моделей и использования в оборудовании ЦОД. В свою очередь, ядро X280 ориентировано на потребительские устройства, такие как гарнитуры дополненной реальности, а X390 также может использоваться в автомобилях и инфраструктурных системах. Последнее ядро выполняет векторную обработку в четыре раза быстрее, чем X280. Все пять продуктов Intelligence Gen 2 уже доступны для лицензирования, а появление первых чипов на их основе ожидается во II квартале 2026 года. SiFive сообщила, что два ведущих американских производителя полупроводников лицензировали новую серию X100 ещё до её публичного анонса. Они используют IP-ядро X100 в двух различных сценариях: одна компания задействует сочетание скалярного векторного ядра SiFive с матричным движком, выступающим в качестве блока управления ускорителем, а вторая использует векторный движок в качестве автономного ИИ-ускорителя.

08.09.2025 [19:09], Сергей Карасёв

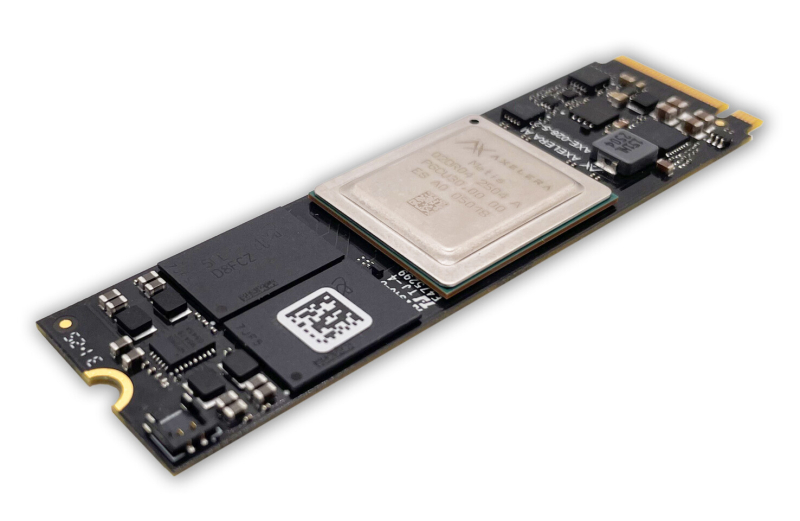

Axelera AI представила ускоритель Metis M.2 Max для ИИ-задач на периферииСтартап Axelera AI B.V. из Нидерландов анонсировал ускоритель Metis M.2 Max, предназначенный для ИИ-инференса на периферии. Новинка может использоваться, в частности, для работы с большими языковыми моделями (LLM) и визуально-языковыми моделями (VLM). Metis M.2 Max представляет собой улучшенную версию изделия Metis M.2, дебютировавшего в 2023 году. В основу положен чип Axelera Metis AIPU, содержащий четыре ядра с открытой архитектурой RISC-V: ИИ-производительность достигает 214 TOPS на операциях INT8. Ускорители выполнены в форм-факторе M.2 2280, а для обмена данными служит интерфейс PCIe 3.0 x4. У модели Metis M.2 Max по сравнению с оригинальной версией в два раза повысилась пропускная способность памяти (точные значения не приводятся). Её объём в зависимости от модификации составляет 1, 4, 8 или 16 Гбайт. Реализованы расширенные средства обеспечения безопасности, включая защиту целостности прошивки. Новинка будет предлагаться в вариантах со стандартным и расширенным диапазоном рабочих температур: в первом случае он простирается от -20 до +70 °C, во втором — от -40 до +85 °C. Благодаря этому, как утверждается, Metis M.2 Max подходит для применения в самых разных областях, в том числе в промышленном секторе, розничной торговле, в сферах здравоохранения и общественной безопасности и пр. Разработчикам компания Axelera AI предлагает комплект Voyager SDK, который позволяет полностью раскрыть потенциал чипа Metis AIPU и упрощает развёртывание коммерческих приложений. Продажи ИИ-ускорителя Metis M.2 Max начнутся в IV квартале текущего года. Устройство будет поставляться отдельно и в комплекте с опциональным низкопрофильным радиатором охлаждения.

03.09.2025 [18:03], Руслан Авдеев

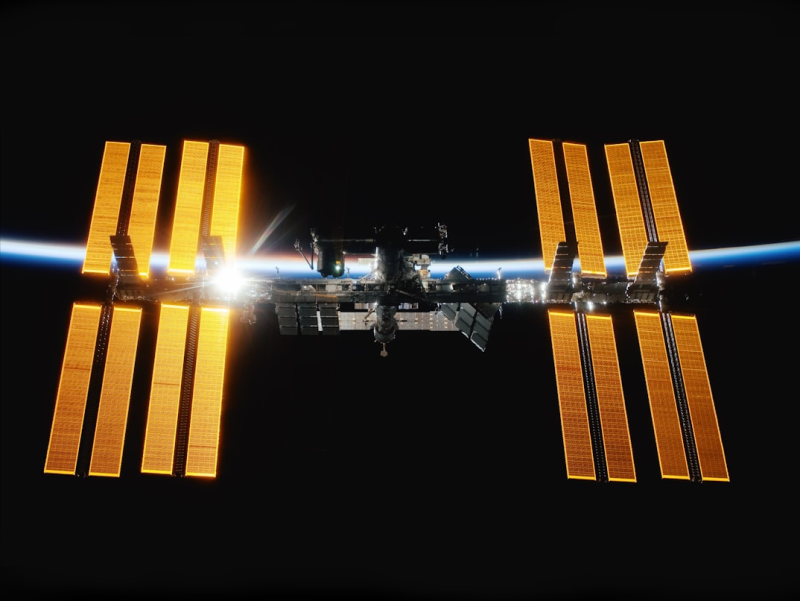

Прототип орбитального ЦОД Axiom Space и Red Hat для экспериментов с периферийными вычислениями прибыл на МКС24 августа Axiom Space и Red Hat отправили на МКС прототип орбитального ЦОД, который уже прибыл на станцию в составе 33-й коммерческой грузовой миссии SpaceX, сообщает Datacenter Knowledge. Целью эксперимента является проверка возможности автономной работы современной вычислительной инфраструктуры в космосе, не полагаясь на зависимость от дорогих спутниковых каналов связи. Новое решение оснащено модулем Axiom Space AxDCU-1, работающем на платформе Red Hat Device Edge, специально разработанной для сред с ограниченными ресурсами. Система использует облегчённый вариант Kubernetes-окружения — платформу Red Hat MicroShift, дающую возможность запускать контейнеризированные рабочие нагрузки в космосе. Задачи выполняются в контейнерах, которые можно удалённо обновлять с Земли. Ключевая особенность системы — её способность работать автономно, без постоянной связи, самостоятельно справляясь с длительными перерывами в коммуникации, которые возникают из-за быстрого движения МКС по орбите. Red Hat Device Edge решает проблему с помощью автоматического отката состояния и функций самовосстановления без вмешательства человека, а также встроенного мониторинга работоспособности и производительности. Для экономии трафика используют дельта-обновления ПО. Сообщается, что дефицит сетевых и вычислительных ресурсов всегда был проблемой на МКС, многие годы было трудно анализировать и передавать данные в режиме реального времени. Орбитальный ЦОД поможет решить эту проблему, с локальной обработкой информации и отправкой на Землю уже готовых результатов. Предполагается, что полезнее всего это будет для экспериментов в сфере естественных наук и биомедицины. В ходе таких исследований часто генерируются большие объёмы данных, но необходимость передавать их на Землю может привести к потерям более ценной и срочной информации. Axiom Space разрабатывает и собственную коммерческую станцию, которая будет оснащена значительными по меркам космоса вычислительными мощностями. По мере развития новой станции будет расти и потребность в масштабируемых, независимых вычислительных средах. «Контейнерный» подход предназначен для поддержки периферийного ИИ, автоматизации и поддержки критически важного ПО на будущих платформах. Впрочем, инновации для космоса найдут место и на Земле, где тоже немало мест с экстремальными условиями. По словам представителя компании-разработчика, извлекаемые «уроки» приносят прямую пользу — повышение надёжности критической инфраструктуры, развитие автономных систем, периферийного ИИ и др. для удалённых или ограниченных в ресурсах регионах напрямую способствуют улучшению качества жизни на Земле.

27.08.2025 [15:17], Руслан Авдеев

Малайзия анонсировала первый собственный ИИ-ускоритель SkyeChip MARS1000Малайзия анонсировала собственный 7-нм ИИ-ускоритель SkyeChip MARS1000, сообщает Bloomberg. Новый чип — первый в стране ускоритель для периферийных ИИ-вычислений. По данным Ассоциации полупроводниковой промышленности Малайзии (Malaysia Semiconductor Industry Association) этот компонент будет применяться в самых разных устройствах от автомобилей до роботов. Чип для периферийных ИИ-вычислений намного слабее, чем передовые решения компаний вроде NVIDIA, которые стоят за работой ИИ ЦОД, обучением больших ИИ-моделей и др. Тем не менее это ключевой шаг на пути создания передовых технологий в соответствующей сфере. Пока нет данных, где именно будет производиться ускоритель. Малайзия давно стремится стать более значимым игроком в мировой цепочке поставок полупроводников, получая выгоду от бума ИИ. Страна уже давно стала ключевым игроком в области упаковки чипов и является производственным хабом для множества поставщиков IT-оборудования. Местные власти поставили долговременную задачу по развитию разработки микросхем, производства полупроводниковых пластин и строительству дата-центров. Правительство обязалось потратить на рост значимости Малайзии в глобальной цепочке «создания стоимости» не менее RM25 млрд ($6 млрд). Попутно Малайзия стремится стать региональным IT-хабом на фоне дефицита мощностей и площадей в соседнем Сингапуре. Правда, усилия осложняются позицией руководства США, которое предложило ограничить поставки ИИ-полупроводников в Малайзию и Таиланд, подозревая, что контрабандисты будут использовать эти страны как перевалочные базы для перепродажи ИИ-ускорителей в государства, находящиеся под западными санкциями — в первую очередь, в Китай. Недавно Малайзия приняла меры по ужесточению реэкспорта ИИ-ускорителей, в которых применяются американские технологии. Власти заявили, что «не потерпят» использования своего государства для незаконной (с точки зрения США) торговли. Не так давно они уже объявляли, что китайская Huawei якобы обеспечит создание суверенной ИИ-инфраструктуры в стране, но вскоре новость была опровергнута на высшем уровне, по мнению экспертов — под давлением Соединённых Штатов.

22.08.2025 [10:09], Руслан Авдеев

От офиса до сборочных линий и складов: Advantech вложит $96,5 млн в новый кампус в СШАТайваньская Advantech, занимающаяся выпуском коммерческих и индустриальных вычислительных платформ, направит $96,5 млн на строительство новой штаб-квартиры в Тастине (Tustin, Калифорния) для расширения деловой активности компании в Северной Америке. Завершение строительства запланировано на III квартал 2026 года. Инициатива, как ожидается, поможет довести выручку в регионе до $1,5 млрд и более, сообщает DigiTimes. В новом кампусе компания разместит офисные помещения, сборочные линии, склады, выставочные и конференц-залы. Также там найдётся место для зон постпродажного ремонта. Это часть стратегии Advantech по укреплению локальных возможностей сборки и обслуживания оборудования, а также расширению присутствия на североамериканском рынке, на который в 2024 году приходилось более 38 % мирового рынка промышленных периферийных устройств, оцениваемого в $21,29 млрд. Эксперты ожидают, что сектор продуктов для периферийных вычислений компании Advantech будет расти приблизительно на 13,4 % в год до 2030 года благодаря развитию соответствующего рынка и ИИ-приложений. Компания намерена укреплять взаимодействие с основными клиентами в регионе и расширять сферу применения своих технологий.

Источник изображения: Suyash Mahar/unsplash.com Хотя у компании имеются определённые трудности вроде новых пошлин и «оптимизации складских запасов» клиентами, компания продемонстрировала значительный рост на ключевом для себя рынке: её выручка в Северной Америке в I квартале 2025 года выросла на 23% год к году, а высокие темпы роста (свыше 20 %) сохранялись в течение всего I полугодия. Компания сотрудничает с отраслевыми партнёрами, включая NVIDIA, ADATA и др. для продвижения инновационных ИИ-решений в промышленности. По словам Advantech, искусственный интеллект и периферийные вычисления играют ключевую роль в цифровой трансформации производственной сферы. Компания намерена продемонстрировать практические шаги по внедрению новых решений. Расширение бизнеса и акцент на передовых технологиях отражают стратегию Advantech по поддержанию долгосрочного роста на североамериканском рынке. Некоторые тайваньские компании идут более извилистым путём. Foxconn продала завод по производству электромобилей в США под давлением ряда факторов компании SoftBank, а теперь сама же займётся там в рамках нового партнёрства выпуском ИИ-оборудования для проекта Stargate.

28.07.2025 [14:16], Сергей Карасёв

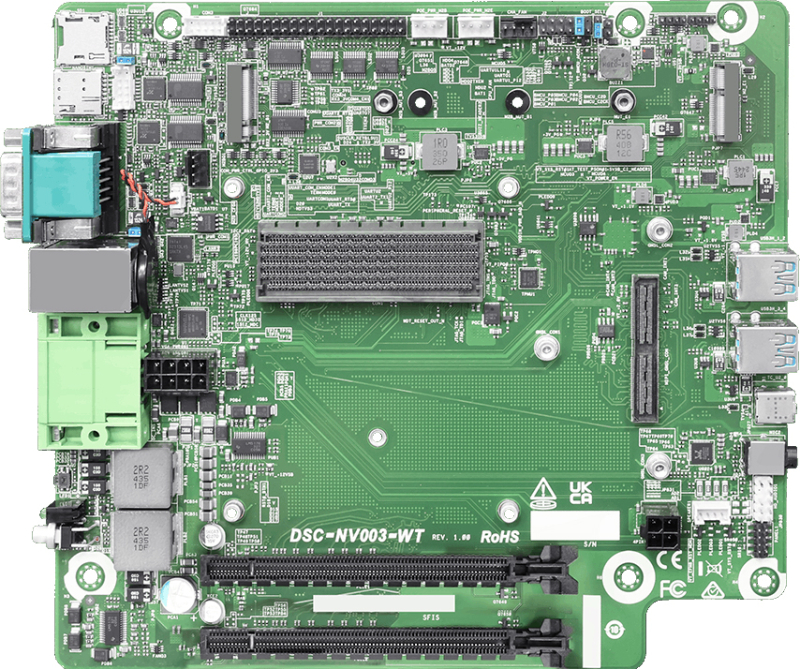

ASRock Industrial представила платформу NVIDIA Jetson AGX Orin для периферийных ИИ-устройствКомпания ASRock Industrial анонсировала комплект для разработчиков NVIDIA Jetson AGX Orin Developer Kit. Решение предназначено для построения периферийных ИИ-устройств, роботов, дронов, дистанционно управляемых систем и пр. В основу новинки положена аппаратная платформа NVIDIA Jetson AGX Orin. Комплект представлен в трёх вариантах — Jetson AGX Orin Industrial (JAOi), Jetson AGX Orin 64GB (JAO 64GB) и Jetson AGX Orin 32GB (JAO 32GB). ИИ-производительность достигает соответственно 248, 275 и 200 TOPS (INT8). Во всех случаях конфигурация включает GPU на архитектуре Ampere, CPU на базе Arm Cortex-A78AE и флеш-модуль eMMC 5.1 вместимостью 64 Гбайт. Версия JAOi несёт на борту 64 Гбайт памяти LPDDR5 DRAM с поддержкой ECC, тогда как модификации JAO 64GB и JAO 32GB укомплектованы соответственно 64 и 32 Гбайт LPDDR5 DRAM. Все варианты располагают коннектором M.2 Key M 2280 для NVMe SSD с интерфейсом PCIe 3.0 x4, разъёмом M.2 Key B 3042/3052/2280 для модема 4G/5G (плюс слот Nano SIM) и коннектором M.2 Key E 2230 (PCIe 3.0 x1; USB 2.0) для адаптера Wi-Fi / Bluetooth. Предусмотрены два разъёма PCIe x16 (на уровне сигналов PCIe 4.0 x8), слот microSD (UHS-I/SDR-50), четыре порта USB 3.2 Gen2x1 Type-A, разъём USB 2.0 Type-C и интерфейс HDMI 2.0. В оснащение входят сетевые контроллеры Marvell_88E1512-A0-NNP2C000 Gigabit Ethernet и Intel I226IT с гнёздами RJ45. Реализованы два последовательных порта RS-232/422/485 через коннектор DB9 и разъём на плате. Кроме того, упомянута 40-контактная колодка с поддержкой I2S, I2C (×2), SPI, UART, CAN(×2), PWM (×2) и пр. Через модули M.2 E Key и B Key, а также карты PCIe могут быть добавлены до 12 портов PoE (IEEE 802.3af) для питания внешних устройств, таких как камеры. Имеется встроенный модуль TPM 2.0 для обеспечения безопасности. Диапазон рабочих температур простирается от -25 до +45 °C. Питание в диапазоне 12–48 В подаётся через DC-разъём. Габариты изделия составляют 190,32 × 210,31 мм.

28.07.2025 [10:14], Руслан Авдеев

Мегаваттный Левиафан: Armada представила контейнерный ИИ ЦОД повышенной мощностиКомпания Armada, занимающаяся созданием дата-центров контейнерного типа, привлекла инвестиций на $131 млн и тут же анонсировала модульный ЦОД Leviathan мегаваттного класса, сообщает Datacenter Dynamics. В очередном раунде финансирования приняли участие Pinegrove Veriten и Glade Brook, а также и прежние инвесторы, включая Founders Fund, Lux Capital, Shield Capital, 8090 Industries, венчурный фонд Microsoft M12, Overmatch, Silent Ventures, Felicis и Marlinspike. Вместе с новостями об инвестициях Armada анонсировала и новый модульный ИИ ЦОД Leviathan с СЖО, который входит в серию Galleon и фактически представляет собой «более крупный аналог» ЦОД Triton с десятикратно повышенной вычислительной мощностью. По словам компании, новый ЦОД можно развернуть в удалённых локациях всего за несколько недель. Например, неподалёку от источников природного газа, объектов альтернативной энергетики и даже атомных станций. По оценкам Armada, в США есть порядка 6 ГВт не до конца освоенных источников энергии. Leviathan мог бы помочь задействовать её для ИИ-вычислений. По мнению компании, доминирование США в сфере ИИ и энергетики зависит от быстрого перемещения огромных вычислительных мощностей на периферию, где генерируются подлежащие обработке данные и есть недорогая энергия. Именно для таких проектов и предназначен Leviathan. Каждый модуль Leviathan обеспечивает мегаваттную производительность за значительно меньшее время, чем традиционные ЦОД — благодаря способности адаптироваться к эволюции ИИ-ускорителей и систем охлаждения и использовать всю доступную территорию и энергию. Ввод проекта в эксплуатацию и дополнительное финансирование ускорят миссию по преодолению «цифрового неравенства» и переходу всего мира на американский ИИ-стек. У Armada уже запланированы совместные проекты с Fidelis New Energy и Bakken Energy, которые будут использовать природный газ для энергоснабжения дата-центров. В 2025 году Armada развернула контейнерные периферийные ЦОД совместно с Tampnet — для морских нефтяных платформ, ВМС США, Aramco в Саудовской Аравии и Newlab в Детройте и Эр-Рияде.

23.07.2025 [12:51], Сергей Карасёв

Ускоритель Hailo-10H обеспечивает поддержку генеративного ИИ на периферииКомпания Hailo сообщила о коммерческой доступности изделия Hailo-10H — ИИ-ускорителя второго поколения, ориентированного на работу с генеративными приложениями на периферии. Новинка доступна в виде интегрируемого чипа COB (Chip On Board), а также в виде модулей формата M.2 Key M 2242/2280. По словам компании. при энергопотреблении всего 2,5 Вт новинка способна выдавать более 10 токенов в секунду на моделях с 2 млрд параметров, при этом на отдачу первого токена уходит менее одной секунды. Также чип позволяет детектировать объекты в режиме реального времени в видеопотоке 4K. По заявлениям разработчика, Hailo-10H позволяет использовать большие языковые модели (LLM), визуально-языковые модели (VLM) и другие модели генеративного ИИ локально — без необходимости подключения к облаку. Это выводит ИИ-возможности периферийных устройств на новый уровень. Кроме того, обеспечивается ряд других преимуществ по сравнению с обработкой информации в облаке. В частности, достигается высокий уровень конфиденциальности, поскольку персональные данные не пересылаются на сторонние серверы, а остаются на устройстве. Отпадает также необходимость оплаты облачных вычислительных ресурсов. Ускоритель Hailo-10H может использоваться в системах с CPU на архитектурах x86 и Arm. Энергопотребление находится на уровне 2,5 Вт. Говорится о совместимости с Linux, Windows и Android, а также с фреймворками TensorFlow, TensorFlow Lite, Keras, PyTorch и ONNX. Изделия в виде модулей М.2 используют интерфейс PCIe 3.0 x4. Объём встроенной памяти LPDDR4/4X составляет 4 или 8 Гбайт. Предусмотрены индустриальный и автомобильный варианты исполнения: в первом случае диапазон рабочих температур простирается от -40 до +85 °C, во втором — от -40 до +105 °C. Производительность Hailo-10H достигает 40 TOPS в режиме INT4 и 20 TOPS в режиме INT8. Ускоритель полностью совместим с программным стеком Hailo. Среди ключевых сфер применения новинки названы автомобилестроение, телекоммуникации, розничная торговля, информационная безопасность, персональные компьютеры и пр.

02.06.2025 [09:02], Сергей Карасёв

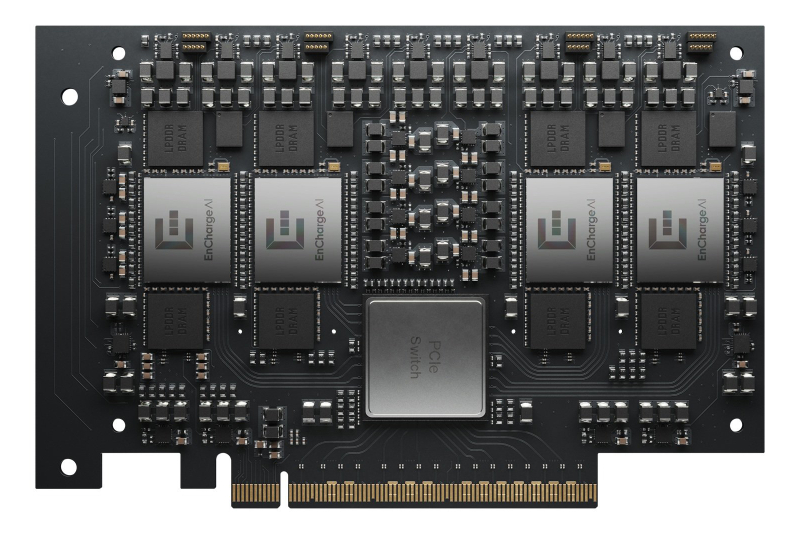

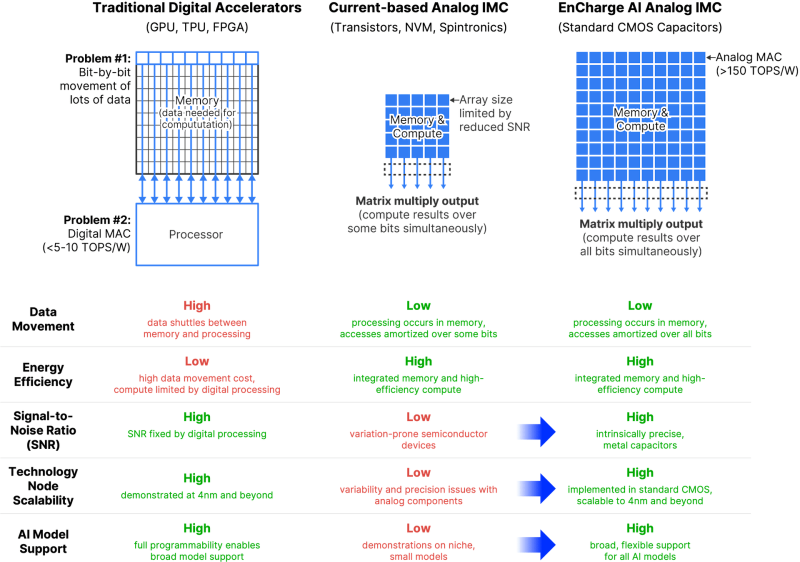

EnCharge AI представила аналоговые ИИ-ускорители EN100Компания EnCharge AI анонсировала изделия семейства EN100 — аналоговые ИИ-ускорители для in-memory вычислений. Дебютировали устройства в форм-факторе M.2 для ноутбуков и карты расширения PCIe для настольных рабочих станций. Стартап EnCharge AI, основанный в 2022 году, разрабатывает чипы, которые дают возможность перенести ИИ-нагрузки из облака на локальные платформы. Для этого применяется концепция вычислений в оперативной памяти, позволяющая увеличить эффективность и устранить узкие места, связанные с перемещением данных. NPU-ядра EnCharge AI, как утверждает сам разработчик, обеспечивают производительность на уровне 40 Топс/Вт (8-бит точность). Ускоритель EN100 для ноутбуков имеет типоразмер M.2 2280. В оснащение входят 32 Гбайт памяти с пропускной способностью до 68 Гбайт/с. Быстродействие превышает 200 Топс при общем энергопотреблении не более 8,25 Вт. Для оркестрации задействована многопоточная архитектура RISC-V. На рабочие станции ориентированы ускорители EN100 в виде карт расширения PCIe HHHL. Они несут на борту 128 Гбайт памяти с суммарной пропускной способностью 272 Гбайт/с. Производительность составляет около 1 Попс. Изделия обоих типов изготавливаются с применением 16-нм CMOS-технологии. Навин Верма (Naveen Verma), генеральный директор EnCharge AI, заявляет, что решения компании позволят выполнять ресурсоёмкие задачи ИИ локально, не полагаясь на облачную инфраструктуру. Утверждается, что такие устройства по сравнению с современными ИИ-ускорителями обеспечат в 20 раз более высокую энергоэффективность (Топс/Вт) и в 9 раз более высокую плотность вычислений (Топс/мм2) при 10-кратном снижении совокупной стоимости владения (TCO). |

|